数据中心节能降耗应从两个方面入手,第一是减少数据中心IT设备对电能的需求,降低其能耗和发热量,第二是提高供电和制冷系统的效率,减少不必要的浪费。今天我们一起讨论下数据中心制冷系统的节能。

数据中心机房单位面积能耗由10年前的400~500W/m2迅速升高到目前的800~1000W/m2,而且还呈现不断上升的趋势。尤其是目前高密度IDC机房设备集成度的提高,已经使单机架的功率大幅度提升。台式服务器机架功率为1.5kW,模块式服务器机架功率为10kW左右,现在最新的刀片式服务器机架功率高达30kW。高耗电,必然产生了高发热,因此IDC机房的空调需求量也大幅度增加。

1.针对数据中心机房IT设备用电功耗及机房散热要求。应采用相对应的机房制冷系统解决方案和机房散热方案: 1)当机房机柜功耗在3~6kW时,建议采用风冷或水冷空调系统,采用面对面,背对背的冷热通道分隔的机房气流组织进行规划和建设。在当地气候允许的条件下,可考虑能效比较高的水冷空调系统和自然风冷冷却方案。当机房局部产生热岛时,可使用有气流导向的变风量送风地板,增强机房热岛区的局部散热。

2.当机房机柜功耗在8~15kW时,建议采用封闭冷通道气流组织进行规划,采用风冷或者水冷空调系统。在机房局部功率产生热岛时,可使用EC风机与送风地板,增强机房热岛区的局部散热;在机房局部产生高功率热岛时,使用机房行间空调封闭局部进行内部增强快速散热。

3.当机房机柜功耗在15~25kW时,建议采用机房行间空调,机柜封闭增强机房热岛区的局部散热,有条件可采用冷板式机柜,柜内热空气与冷却水在柜内进行热交换的冷却技术。

4.当机房功率大于25kW时,考虑更加高效的散热冷却技术,采用液冷技术,高密度服务器高度热品质冷却系统。

从以上方案,我们可以看出,对于传统的低功率机柜,利用风冷空调制冷技术即可满足其运行条件。当功率大于10kW时,需采用封闭通道并采用行间空调制冷。当功率大于15kW时,需采用冷板式制冷技术满足机柜运行需要。当功率大于25kW时,考虑更加散热高效的浸没式液冷技术。

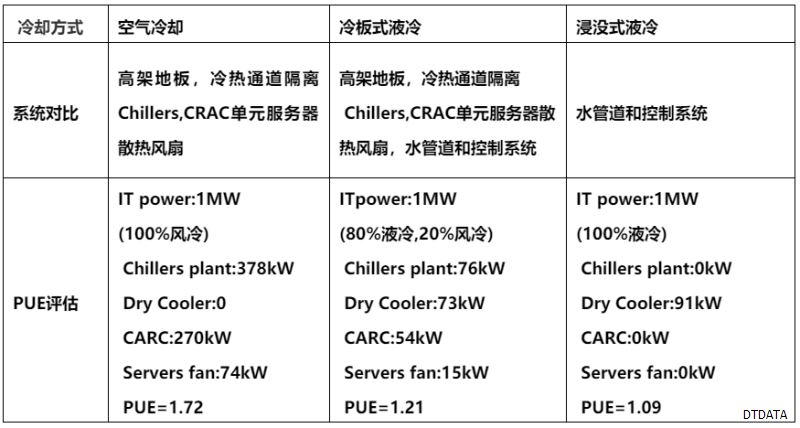

云数据中心发展趋势为大规模、高密度机房,传统的空调制冷方式将很难满足未来的数据中心运行要求。如何更加高效节能,我们对比一下上述液冷技术路线与传统技术性能PUE。 2. 不同冷却技术能耗对比对比传统空气冷却、冷板式、浸没式液冷,不考虑外界环境因素变化,三种技术对比如下:

总结

分析三种技术运行工况,制冷系统制冷能耗总体不断降低。冷板式对于传统风冷冷却技术能够有效大幅度降低能耗,浸没式液冷能够更进一步节能降耗,PUE可以达到1.09。随着国内对数据中心节能指标控制越加严格,PUE有更进一步降低的趋势,有此可见,浸没式液冷在高功率、大规模数据中心节能应用存在广阔的前景。随着技术不断发展,数据中心制冷系统将会更加高效节能。